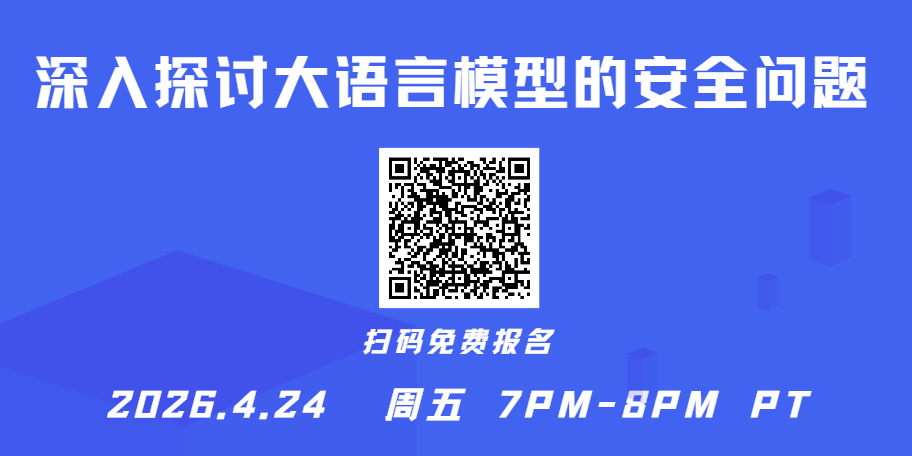

深入探讨大语言模型的安全问题

April 24 @ 7:00 pm - 8:00 pm PDT

为何每一位AI工程师现在都必须理解LLM安全?

人工智能已不再仅仅是一个研究课题——它现已深度嵌入现代商业的核心之中。从AI 副驾驶(Copilots)和聊天机器人,到自主智能体(Agents)和企业知识系统,大型语言模型(LLMs)正在彻底改变我们构建软件、制定决策以及与数据交互的方式。然而,随着其应用加速普及,一个关键问题随之浮出水面:这些系统真的安全吗?在LLMs令人惊叹的能力背后,潜藏着一个正在迅速扩大的攻击面——而大多数开发者、产品经理,甚至连AI工程师,都尚未做好充分的准备来应对它。正因如此,我们特此举办一场专题网络研讨会:

深入探究大型语言模型的安全问题 – LLM系统潜藏的风险

与传统的软件系统不同,LLMs 引入了全新类别的安全挑战:

* 仅仅通过一个简单的 Prompt(提示词),就能改写系统的既定行为

* 敏感数据可能会被从模型的响应内容中提取出来

* 外部文档可能会在无声无息中 注入恶意指令

* AI 智能体可能会执行未经授权的现实世界操作

这些绝非纸上谈兵的理论风险——它们正真实地发生在我们身边。那些正在部署基于 LLM的系统的组织,如今已面临着以下挑战:

* 提示词注入攻击(Prompt Injection)

* 数据泄露事件

* 绕过安全控制(Jailbreaking)

* RAG管道操纵攻击

* AI智能体对API和工具的滥用

你将从本次研讨会中学到什么?

本次研讨会旨在超越浅层探讨,为您提供对LLM安全领域深入且具备技术深度的理解。你将学到:

1. LLM(大型语言模型)威胁概览

* 为何 LLM 在本质上与传统系统截然不同

* 由提示词(Prompts)、记忆机制和工具引入的全新攻击面

* AI 系统故障的真实案例

2. 核心攻击技术

* 提示词注入(Prompt Injection)与“越狱”(Jailbreaking)

* 数据提取与隐私泄露

* RAG 投毒与检索操纵

* 对抗性输入与编码攻击

3. AI 智能体(Agents)中的安全风险

* LLM 如何与 API 及外部工具进行交互

* 自主决策带来的风险

* 未经授权操作的真实场景

4. 防御策略与安全架构

* 如何设计安全的LLM应用

* 安全护栏(Guardrails)、内容过滤与策略强制执行

* 监控、日志记录与实时攻击检测

* 领先AI公司采用的最佳实践

本次网络研讨会专为以下人群打造:

* AI / LLM工程师

* 数据科学家

* 后端与全栈开发人员

* 负责 AI 功能的产品经理

* 正在构建 AI 产品的初创企业创始人

加入我们,如果你希望:

* 深入理解LLM系统可能遭受的攻击方式

* 学习如何为你的AI应用构建防御体系

* 在瞬息万变的AI领域中保持领先地位

————————————-

主办方:数据应用学院

数据应用学院是北美首家集培训、项目实习和内推于一体的机构,我们的项目导向课程专注学员成果,并提供职业发展指导。感兴趣的小伙伴可以点击下面的链接,解锁更多专业技能:

最新直播课程——大语言模型开发者训练营:https://study.dataapplab.com/course?courseid=llm-developer-bootcamp-2603

在售录播课程列表:https://study.dataapplab.com/pages/home

数据科学家求职训练营精华课:https://study.dataapplab.com/course?courseid=dstraining

商业分析师求职训练营精华课:https://study.dataapplab.com/course?courseid=ba-training