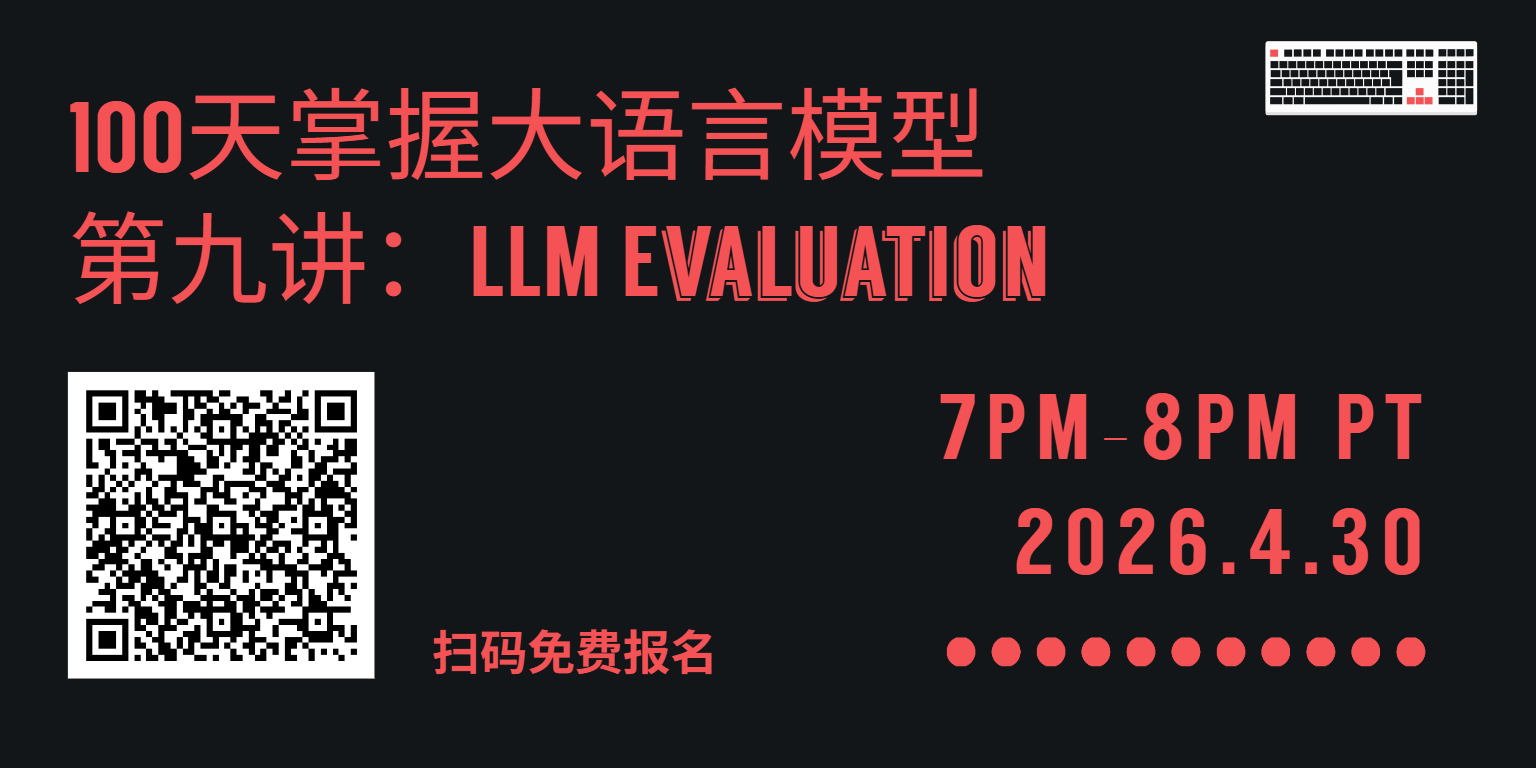

100天掌握大语言模型-第九周:如何判断你的LLM是否真的有用?

April 30 @ 7:00 pm - 8:00 pm PDT

| “你在LLM看到的每一个指标都只是质量的替代指标,而不是质量本身。第九周会教你哪些替代指标值得信赖,哪些指标会欺骗你,以及如何区分它们。” |

45分钟内你将学到什么

大多数从业者都知道各种评估指标的名称。但很少有人理解为什么 BLEU 不适用于开放式问题生成,为什么困惑度在不同的分词器中毫无意义,或者为什么在基准测试中获得 90% 分数的模型可能过于自信,存在安全隐患。本次课程将弥补这些知识空白。

| 内在指标

困惑度:它实际衡量的是什么,以及为什么不能在不同的分词器之间进行比较。BLEU:n-gram 精确度计算的详细步骤,以及为什么它在任何包含释义的任务中都会失效。ROUGE:所有四种变体(R-1、R-2、RL、RS)及其示例,以及为什么必须始终报告所有三种变体的结果。 |

语义度量

BERTScore :使用上下文嵌入的精确率、召回率和 F1 值计算公式。为什么“automobile”和“car”在 BLEU 上的得分接近于零,但在BERTScore上却能达到 0.94 ? MoverScore和 BLEURT:何时使用它们以及计算量与相关性之间的权衡。 |

| 基准测试套件

GLUE、 SuperGLUE 、MMLU——它们分别测试什么、当前最先进的性能指标,以及为什么每个基准测试最终都会饱和(古德哈特定律的体现) 。HumanEval pass@k用于代码测试,MT-Bench 和AlpacaEval用于指令执行测试,Chatbot Arena Elo 用于真实世界聊天质量测试。 |

人与法学硕士——法官

三种人工评估方案:直接评估、并排A/B测试和错误标注。然后是LLM作为评判员——GPT-4自动化评估器,它能以极低的成本达到与人类评估结果约80%的一致性,以及您必须控制的四种偏差。 |

评估差距导致团队浪费数月时间

以下是使用语言学习模型 (LLM) 的工程团队在实践中反复遇到的情况。一个模型在 MMLU 测试中得分 86%。团队发布了该模型。用户抱怨它在他们特定领域给出了错误的答案。团队在摘要流程中添加了 ROUGE 算法。由于 ROUGE 算法奖励与训练参考文本重叠的 n-gram,输出结果变得更短、更公式化。他们又在翻译工作流程中添加了 BLEU 算法。翻译质量确实有所提高——但一个逐字复制源文本短语的模型也能达到同样的水平,而且该模型在 BLEU 测试中也获得了很高的分数。

这些失败的根本原因都一样:团队知道指标名称,却不知道指标的具体含义,也没有进行实际测量。第九周的课程将解决这个问题。你将获得一个决策表——包含八种任务类型和三列指标——你可以立即将其应用到任何项目中。

| 约0.40

BLEU 与 MT 的人类判断的相关性 |

约0.60

BERTScore与人类判断的相关性 |

约0.80

GPT-4 作为评判员的相关性——接近人类评判员的一致性 |

| 关键数据:GPT-4 作为评判工具,其评判结果与人类偏好的一致性达到了 80%——与人类标注者之间的一致性相当——而成本却仅为人工研究的大约 1/100。了解何时使用(以及何时不使用)GPT-4,是 2025 年LLM工程师最实用的技能之一。 |

谁应该参加

| 机器学习工程师 | 那些不断迭代优化配方,并在开发过程中需要可靠信号来区分更好和更差的模型版本的人。 |

| 数据科学家 | 那些生产 LLM 输出结果的人需要知道他们的评估设置是否真正衡量了他们认为正在衡量的东西。 |

| 人工智能产品经理 | 审阅模型评估报告的人需要提出正确的问题,了解这些数字能告诉他们什么,不能告诉他们什么。 |

| 研究人员 | 撰写 NLP 论文的人需要选择审稿人会接受且能真正支持其论点的指标。 |

| LLM申请构建器 | 哪些人正在开发聊天机器人、摘要器或代码助手,并且需要一种实用的质量保证方法? |

| 系列中的所有人 | 第 9 周是第 10 周(RLHF)的评估基础——人类偏好数据是进行一致性训练的信号。错过第 9 周,第 10 周的训练将会更加困难。 |

第 9 周在整个系列中的位置

第 9 周是本系列的评估层。过去八周我们构建的所有内容——架构、预训练、微调、PEFT、RAG——都需要评估才能改进。而评估是第 10 周的先决条件,第 10 周将介绍 RLHF:基于人类反馈的强化学习,其中我们在 A/B 测试中收集的人类偏好数据将成为实际的训练信号,用于对齐。