你点开这篇文章,是不是以为我会讲《点球成金(Money Ball)》?这篇文章会有点不一样。

本文中,我重点介绍了 4 部电影,它们揭露了当今不负责任地利用数据科学以及数据相关技术对日常生活和社会造成的悲剧性影响。

真的假的?数据科学对社会有破坏性影响吗?答案是肯定的。就在几周前,《华尔街日报》(Wall Street)发表了一系列基于 Facebook 内部文件的文章,揭示了 Facebook 出现的一系列数据滥用相关问题。事实证明,Facebook 在其平台上支持人口贩卖网络;其排名算法扩散了更多误导信息;Facebook 旗下的 Instagram 可能不利于十几岁的女孩成长等等。

链接:https://www.wsj.com/articles/the-facebook-files-a-podcast-series-11631744702

这些问题是由 Facebook 数据收集、Facebook 排名算法的方式、使用的参与度指标,以及一系列利润大于用户的(糟糕的)决策所造成。如果这些问题的出现不是因为数据科学,,那究竟是什么导致的呢?

可悲的是,《Facebook 文件》并不是第一份有关数据滥用及其对社会的破坏性影响的报告。在过去的几年里,一些书籍(《Don’t be evil》、 《Weapons of Math Destruction》,电影(“The Social Dilemma”, “Coded Bias”, “The Great Hack”, “Brexit: the uncivil war”,)以及一些组织(Center for Humane Technology, The Algorithmic Justice League)逐渐增加了人们对这些问题的认知,强调数据滥用如何渗透到推销技术、决策不当以及监管不力,威胁人类健康、日常生活,甚至整个社会。

为什么这对数据科学家很重要?我们作为数据科学家,可以利用相关技能帮助人类,造福社会。通过数据相关的技术,我们肯定可以受益颇丰。我们可以帮助球队,就像电影“点球成金(Money Ball)”里的那样。反过来,如果我们不负责任地使用相关技能,我们创造的数据产品可能会带来实质性的伤害。毕竟,公司是人经营的,决策也是由人做出的,算法和数据产品是由数据科学家设计的。

电影✦

以下 4 部电影,有的是纪录片,有的是剧情,也有两者的混合,主要揭示了滥用数据和人工智能对政治、公共卫生、以及对社会不同部分的负面影响。以下电影展示了产品带来损害的原因,以及公司最终决定如何设计这些产品,同时还提供有关公司发展的建议。

✦✦1 监视资本主义:智能陷阱

(The Social Dilemma)

智能陷阱(The Social Dilemma)是今年非常有名的纪录片,今年获得了7项提名和2项艾美奖(Emmy Awards)。该电影揭示了社交媒体平台如何在传播阴谋论、假新闻和虚假信息的同时,制造成瘾、操纵人们的意见和行为。这些问题是通过滥用劝服技术造成的,而这些技术目的在于吸引用户注意力,并尽可能长时间让他们停留在某个平台上。创造算法的时候,也只是优化用户在平台上花费的时间和/或消费的内容量,而不管该内容的质量或准确性如何。

电影中说到,社交媒体平台之所以争夺用户的注意力,是因为通过这种方式,他们可以通过向用户展示付费广告来获取利润。

这部电影采访了Google、Facebook 和 Twitter 等大型科技公司的前员工和高管,他们提供了算法设计方面的第一手资料。

【点击此处观看预告片】:https://youtu.be/uaaC57tcci0

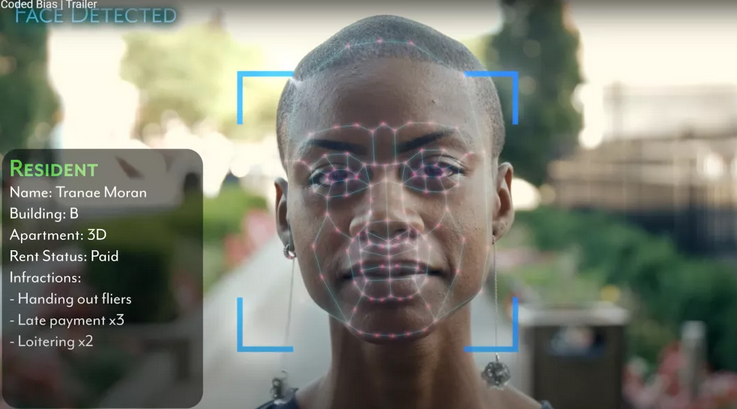

✦✦2 编码的偏见(Coded Bias)

电影“编码偏见”荣获了多项奖项,讲述了麻省理工学院媒体实验室(MIT Media Lab)研究员乔伊·博拉姆维尼 (Joy Buolamwini) 的经历。他发现,面部识别算法无法正确识别有色人种和女性的面孔。这一发现表明,虽然大部分人认为,我们使用的人工智能工具能够可能准确预测,但实际预测结果并没有那么精确,或者至少不适用于所有人。换句话说,我们今天使用的许多人工智能工具都存在种歧视(种族歧视或性别歧视),从而对社会的各个部门都产生了巨大的影响。

该电影探讨了偏见背后的原因,以及这种偏见给不同人群带来的影响,强调了社会弱势群体受到的打击更严重。

点击此处观看预告片:https://youtu.be/jZl55PsfZJQ

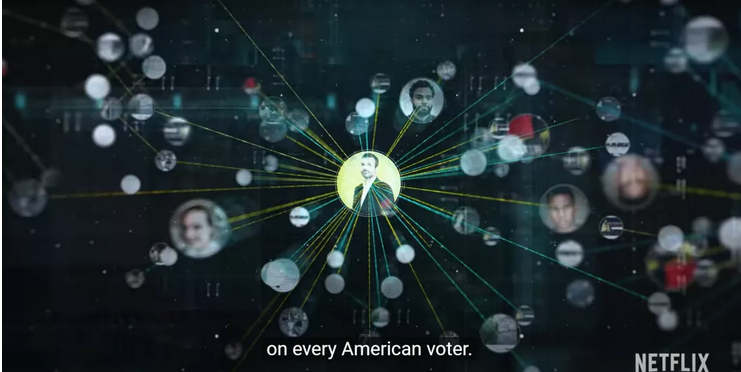

✦✦3 个资风暴:剑桥分析事件(The Great Hack)

个资风暴(The Great Hack)是一部关于 Facebook与Cambridge Analytica公司数据丑闻的纪录片,可以说是刚刚提到的“Facebook 文件”前最大的丑闻了。这部电影展示了剑桥分析公司在定向广告活动中的数据滥用,以及这些数据对多个国家政界带来的影响,包括英国脱欧公投,以及美国的 2016 年大选。这部电影揭露了 Cambridge Analytica 与科技社交媒体巨头 Facebook 之间的关系,以及他们如何在用户不知情的情况下共享用户数据。

这部电影讲述的是《卫报The Guardian》的一名记者揭露了这件事,以及 Cambridge Analytica 公司的一名前雇员成为揭发者的故事。

点击此处观看预告片:https://youtu.be/iX8GxLP1FHo

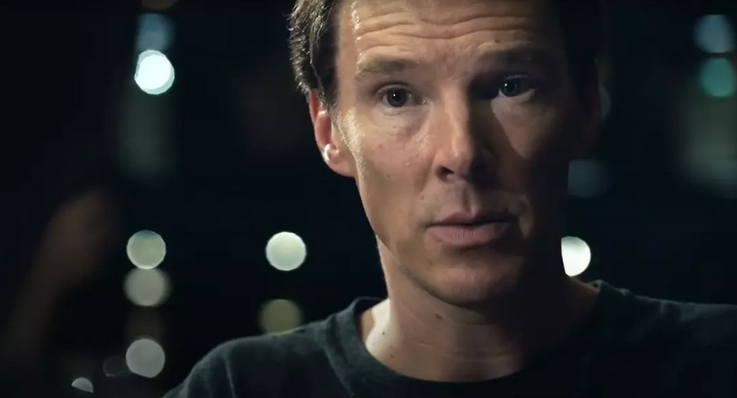

✦✦4 脱欧:无理内战(Brexit: the uncivil war)

脱欧:无理内战(Brexit: the uncivil war)是一部剧情片,根据英国脱欧公投之前“脱欧(Vote Leave)”运动背后的战略真实故事改编,该事件促使英国退出了欧盟。该电影展示了如何(错误地)使用社交媒体和互联网等营销工具,如何通过微定位广告而导致英国的脱欧。

本尼迪克特·康伯巴奇(Benedict Cumberbatch)在这部电影中扮演脱欧运动策略的幕后策划者,演技非常出色。

点击此处观看预告片:https://youtu.be/YP68FBMK6h4

那么,我们是否可以防止数据技术的滥用呢?

上述这些电影突出了滥用数据和数据相关技术,对当今当今社会造成的破坏性影响。这些问题是由于缺乏对数据使用的监管,导致科技公司为所欲为。所以,解决方案很简单:我们需要加大监管力度,防止技术滥用,并鼓励这些技术为人民和社区福祉服务,而不仅仅是为了利润。

不幸的是,由于大型科技公司在游说活动上投入了大量资金,新法规的实施将非常耗时。事实上,Google、Facebook 和Microsoft是是欧盟游说支出最大的公司,Facebook 和Amazon是美国当今游说支出最大的两家。

因此,目前看来,我们必须采取一些措施,防止滥用技术。毕竟,数据科学家是创造这些产品的人。不是吗?

那么,我们能做些什么?

本文讨论的大多数电影,都是以大型科技公司前员工为背景。他们要么提出了自己的意见,但却无人倾听;要么决定离开公司,因为他们意识到自己正在创造的技术没有服务于人们的最大利益。如果我们刚好参与了破坏性技术的开发,我们也可以像他们这样,勇敢地站出来,发出自己的声音,说出我们的担心,并尝试将产品设计引向正途。

一些前科技公司员工后来资助了一些非政府组织,如人道技术中心(Center for humane technology),或者是算法正义联盟(Algorithmic Justice League),这些组织为人道主义使用技术而战,或者为负责任、公平使用人工智能而战。而事实上,人文技术中心为数据产品设计人员提供了大量资源,支持我们构建人文技术,并帮助我们引导公司内部讨论。

既然谈到了引导讨论,让我们来讨论数据科学和数据相关技术。

我们可能在互联网上读过很多文章,说“数据科学是 20 代中最性感的工作”,而数据科学、机器学习和软件工程的薪资最高。我不知道你是怎么想的,但当我和我的(大多数) 同事交谈时,这些话题似乎都是在谈钱,谈最新的技术,以及为某某“知名”(大型科技) 公司工作。这些似乎是成功的标志。我很少听到有人讨论或反思我们所做的事情是否真的有意义,是否真的有用。

因此,我们可以正确引导对话。我们可以改变讨论数据科学的方式。不要将成功与薪水或我们工作的公司联系在一起,不如让我们想一下,我们通过自身技能设计的产品以及挣来的钱是否真的有用。这些数据产品是否在某种程度上改善了社会福祉?我们是否有助于预防犯罪?改善公共卫生吗?支持良好互动?我们的算法公平吗?

如果我们对这些答案不满意,为什么不友好地拒绝这份工作,去找其他工作呢?

我认为,这对我们这些数据科学家来说是很重要的,那些真正有能力创造消费数据的产品并根据数据做出决定的人要明白,并不是每个产品都是好产品,有些产品确实是非常没有什么好处的。我们有发言权,因为我们要对自己设计的产品负责。我们可以创造为人民和社区服务的产品,避免开发具有破坏性或道德上不负责任的产品。

在关于如何正确利用/错误利用数据,和算法的监管开始出现之前,考虑到大型科技公司在游说反对监管上投入的大量资金,我们还有很长的路要走,一切都取决于数据科学家、机器学习工程师,以及那些真正有能力创造这些产品的人。他们必须负责任地使用技能,然后说,不,我不想参与其中,我要更好地利用这些技能。

你是他们其中的一员吗?欢迎在评论你分享你的看法。

原文作者:Sole from Train in Data

翻译作者:Lia

美工编辑:过儿

校对审稿:Jiawei Tong

原文链接:https://trainindata.medium.com/the-4-movies-every-data-scientist-should-watch-56809d2c7d7d